![]()

Un jurado en Los Ángeles acaba de declarar a Meta y YouTube responsables del daño psicológico de una joven. Pero el verdadero veredicto no es contra una empresa: es contra un sistema que todos alimentamos.

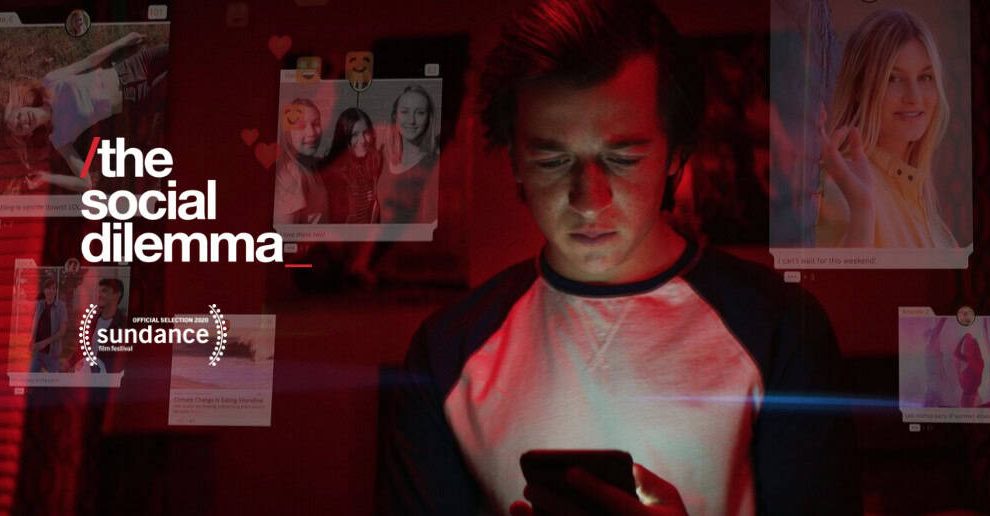

Hace unos días, un jurado en Los Ángeles dictó algo que muchos sentíamos, pero que nadie se había atrevido a poner en papel legal: Meta y YouTube son responsables del daño psicológico sufrido por una joven que se volvió adicta a sus plataformas. Seis millones de dólares en indemnización. Más de cuarenta horas de deliberación. Un precedente que podría multiplicarse en miles de demandas. Y sin embargo, creo que el problema de fondo no está en un tribunal. Ni siquiera en Mark Zuckerberg sentado en el banquillo. El problema está en nosotros. No se trata solo de Meta. Se trata de todas las redes sociales. Todas. TikTok, Snapchat, X, la que ustedes quieran nombrar. Porque el documental El dilema de las redes sociales, que sigue tan vigente como el día que se estrenó en Netflix, ya lo advertía con una claridad que da nervio: hay dos industrias que llaman a sus clientes usuarios, la de las drogas ilegales y la del software. Y nosotros seguimos conectándonos como si eso fuera solo una frase ingeniosa y no un diagnóstico.

¿No te parece extraño que en un mundo que se mueve a la velocidad de un scroll con el dedo, detenerse a reflexionar sea casi un acto de rebeldía?

Lo que más me inquieta no es que un jurado haya fallado contra las grandes empresas tecnológicas. Lo que me pone a pensar es que ya llevamos años viviendo dentro de un sistema que diseñamos entre todos, “sí, entre todos”, y que hemos normalizado a tal grado que cuestionar su lógica parece una locura. Vivimos en una cosmovisión donde la economía y la mercadotecnia se impregnaron en cada rincón de nuestra vida cotidiana. Todo es contenido. Todo es interacción. Todo es alcance. Y lo peor es que lo aceptamos sin pensar. Los algoritmos no detectan qué está bien y qué está mal. No distinguen entre un video educativo y una espiral de comparación tóxica. Funciona con una sola lógica: lo que te retiene, te lo repite. Y en esa repetición, algo humano se va desdibujando. El documental de Jeff Orlowski lo deja claro: las plataformas crean sistemas de recompensa inmediata —los likes, las notificaciones, el desplazamiento que pareciera infinito— que manipulan la dopamina como quien abre y cierra una llave de agua. Y uno podría señalar a los ingenieros de Silicon Valley como los villanos de esta historia, pero la verdad es más incómoda: el sistema funciona porque nosotros lo usamos, lo alimentamos, lo necesitamos. Somos los que damos like, los que compartimos, los que pasamos horas deslizando la pantalla antes de dormir. Somos, al mismo tiempo, el producto y el consumidor. Ahora bien, y aquí es donde creo que vale la pena no caer en el discurso fácil: satanizar las redes sociales sería tan irresponsable como ignorar sus daños. Porque también hay que reconocer lo que han logrado. Gracias a las redes, personas a las que ninguna empresa les daría una oportunidad están generando ingresos dignos a través de la creación de contenido. Jóvenes que no encontraron espacio en el sistema tradicional hoy tienen voz, audiencia y sustento. Comunidades enteras han encontrado en estas plataformas un lugar para organizarse, para denunciar, para existir. El problema no es la herramienta. El problema es la ausencia de estructura.

El caso de Kaley no es un caso aislado. Es un espejo. Es el reflejo de millones de niños que están siendo educados, no por sus padres ni por sus maestros, sino por un algoritmo que no tiene la menor idea de lo que es la compasión, el amor, el perdón.

¿Y qué significa estructura en este contexto? Significa que no hemos sido capaces de construir un marco ético, legal y educativo que le ponga límites a lo que el algoritmo puede hacer con nuestras emociones. El veredicto de Los Ángeles es apenas el primer ladrillo. El caso de Kaley, la joven que comenzó a usar YouTube a los seis años e Instagram a los nueve, no es un caso aislado. Es un espejo. El reflejo de millones de niños y adolescentes que están siendo formados por un algoritmo que no tiene la menor idea de lo que es la compasión, la prudencia o el sentido común.

Me pregunto si no estamos viviendo en una especie de locura consensuada. Una locura en la que ser cuerdo, “detenerse, cuestionar, desconectarse”, se ha convertido en lo raro. En lo incómodo. Inclusive este mismo texto podría parecerle a alguien una exageración, un grito innecesario en un mundo que ya aprendió a convivir con el ruido. Pero justamente ahí está el síntoma: cuando la cordura parece locura, algo grave está pasando. Hemos construido un mundo donde lo espectacular vale más que lo verdadero, donde el escándalo genera más clics que la reflexión, donde el algoritmo premia la indignación por encima de la comprensión. Y en ese mundo, la educación —la verdadera, la que nos enseña a pensar y no solo a reaccionar— se queda sin espacio.

No creo que la solución sea apagar las pantallas ni regresar a un mundo sin tecnología. Eso sería tan ingenuo como pensar que el problema se resuelve con una demanda millonaria. La solución, me parece, está en algo más difícil y más humano: aprender a habitar este mundo digital sin perder lo que nos hace personas. Recuperar el asombro que no necesita validación. Enseñar a nuestros hijos —y enseñarnos a nosotros mismos— que la vida no se mide en likes, sino en encuentros reales con el otro. Porque al final, el dilema de las redes sociales no es un dilema tecnológico. Es un dilema profundamente humano. Y como todo dilema humano, solo se resuelve mirándolo de frente.

Comentar