“la inteligencia artificial puede potenciar las capacidades cognitivas del ser humano, pero nunca podrá —ni deberá— sustituir la sabiduría humana”

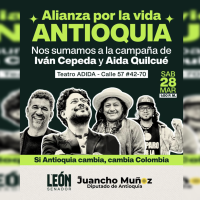

Immanuel Kant, el filósofo que fundamentó la dignidad humana en la obligación de tratar al individuo siempre como un fin en sí mismo y nunca como un medio (Kant, 2012), articuló su sistema filosófico sobre el concepto de «crítica». En términos fundamentales, esta noción representa un examen exhaustivo, un juicio o un test de racionalidad y validez científica.

A través de su trilogía crítica —Crítica de la razón pura, Crítica de la razón práctica y Crítica del juicio—, Kant somete a un escrutinio epistemológico la metafísica, la moral, la lógica, la física y la matemática. Su conclusión es determinante: solo es válido aquel conocimiento que pueda ser verificado o constatado, ya desde la experiencia sensible, a través del dictamen de los sentidos o por medio de las relaciones lógicas (coherentes). Bajo este estándar, la metafísica no alcanza el estatus de conocimiento científico, porque es un conocimiento que no puede ser verificado en un laboratorio, por ejemplo y a su vez escapa a la racionalidad estricta de la lógica (Kant, 2005).

Por racionalidad se entiende en términos sencillos la capacidad de pensar por sí mismo, de tomar sus propias decisiones con autonomía, de acuerdo con lo que Kant denomina “mayoría de edad”; refiriéndose precisamente, a quienes tiene la capacidad de pensar por sí mismos.

Parodiando a Kant nos atrevemos a proponer el concepto de “critica de la razón artificial”, aludiendo a la denominada inteligencia artificial. Con lo cual se pretende someter a un juicio de validez o de racionalidad este tipo especial de racionalidad. El concepto de crítica de la razón artificial es entonces una creación nuestra adoptado en el sentido kantiano de sometimiento a un juicio de validez para la denominada inteligencia artificial (IA), comprendida aquí como una modalidad específica de racionalidad. El objetivo no es determinar si la IA constituye una ciencia en sentido estricto, sino intentar resolver una cuestión fundamental: ¿qué tipo de racionalidad constituye la denominada inteligencia artificial? ¿Será que la denominada IA es capaz de pensar por si misma?

La IA bajo el método kantiano: ¿racionalidad genuina o mera imitación?

Al aplicar el método del filósofo de Königsberg, es posible ejecutar un test de racionalidad a la IA para precisar su naturaleza. La conclusión depende, necesariamente, de la acepción de «inteligencia» que se adopte. Al respecto, se distinguen dos perspectivas clásicas: la racionalidad funcional y la conciencia fenomenológica (Nagel, 1974).

- Racionalidad funcional: este enfoque define la inteligencia como la capacidad de procesar información, aprender, resolver problemas y tomar decisiones de manera autónoma. Dado que la IA ejecuta estas funciones con eficacia, podría catalogarse como una forma de inteligencia real y auténtica.

- Conciencia fenomenológica: Desde esta óptica, la IA sería una mera imitación de la inteligencia orgánica humana: una pseudointeligencia. Esta postura sostiene que la inteligencia requiere autoconciencia y experiencias subjetivas (tales como el amor, el dolor o la esperanza), dimensiones que la IA es incapaz de sentir. La máquina solo puede emular o identificar estos estados, pero no vivirlos desde la subjetividad.

En este análisis es imperativo considerar a John Searle (1980), quien argumenta que la IA posee una notable capacidad sintáctica (procesamiento de símbolos según reglas), pero carece de capacidad semántica (comprensión del significado). Aunque el funcionalismo sugiere que la IA podría desarrollar conciencia en el futuro, en el estado actual de la técnica dicha posibilidad no deja de ser una especulación carente de verificación.

Se infiere, por tanto, que la inteligencia artificial es de naturaleza lógica: relaciona coherentemente signos, conceptos y juicios a través del lenguaje, pero no posee una inteligencia emocional, crítica o creativa. Incluso en el ámbito de la lógica, la IA se especializa en la «lógica del juicio» (la respuesta o tesis) y no en la «lógica erotética» (la pregunta). La IA destaca por su capacidad de respuesta, pero carece de la facultad de formular preguntas espontáneas nacidas del asombro o la admiración, rasgos inherentes a la inteligencia humana (Harari, 2024).

De la inteligencia a la sabiduría (phronesis)

Pero una cosa es la inteligencia y otra cosa es la sabiduría. La sabiduría hace parte de la razón y en especial de la racionalidad humana (Aristóteles, 2014). Y entonces en este escenario surge entonces un interrogante: ¿por qué hablamos de «inteligencia artificial» y no de «sabiduría artificial»? Probablemente porque la sabiduría exige una experiencia subjetiva y consciente, qué en términos kantianos es el Yo autónomo, que la IA no posee (Aristóteles, 2014).

Mientras que una herramienta digital puede describir las diferencias cromáticas entre una manzana roja y una verde, es incapaz de experimentar la diferencia cualitativa de sus sabores. La corporeidad orgánica permite un conocimiento directo y sensible que la estructura mecánica de un sistema informático no puede replicar.

El placer de beber agua, el proceso emocional tras una traición o la satisfacción de un logro académico generan un conocimiento experiencial cualitativo. La IA puede modelar o identificar estos fenómenos, pero no sentirlos. Este conjunto de vivencias constituye la phronesis o sabiduría práctica, una dimensión que, hoy por hoy, resulta inalcanzable para la tecnología (Aristóteles, 2014).

Regulación y gestión del riesgo

La preocupación ante la posibilidad de que la IA supere la inteligencia humana y adopte decisiones autónomas de riesgo no es infundada (Harari, 2024). No obstante, la respuesta no debe ser la prohibición tecnofóbica ni la confianza ciega, sino una regulación prudente basada en «líneas rojas».

Este es el enfoque de la Ley de Inteligencia Artificial de la Unión Europea (Parlamento Europeo, 2024), que establece una clasificación de riesgos:

- Riesgo inaceptable: incluye herramientas de puntuación social o reconocimiento biométrico masivo, las cuales deben ser prohibidas por vulnerar derechos fundamentales.

- Riesgo alto: aplicaciones en diagnósticos médicos o decisiones judiciales, que requieren transparencia y supervisión humana constante (human-in-the-loop).

- Riesgo moderado o mínimo: algoritmos de recomendación o asistentes conversacionales (chatbots), sujetos a principios de privacidad y transparencia.

Conclusión

El progreso tecnológico es irreversible. Ante el avance de la inteligencia artificial, la postura más razonable no es el temor absoluto ni la fe ciega, sino el uso responsable. Dado que estos sistemas también incurren en errores y «alucinaciones», deben ser considerados herramientas complementarias. La inteligencia artificial es racional, pero no racional genuina y espontánea y además carece de consciencia interna y por ende carece además de autonomía; razón por la cual, si sometiéramos a la crítica kantiana la “racionalidad artificial” la conclusión más plausible es que la inteligencia artificial no es racional; pero, obviamente este juicio es anacrónico y por ende injusto; puesto que Kant no existe ya y no sabríamos con exactitud cómo juzgaría Kant en la actualidad a la Inteligencia artificial.

En todo caso el juicio que se hace de la IA es la luz del pensamiento kantiano en un contexto de la modernidad distinto al actual. En la época de Kant no existía la inteligencia artificial y en la época de la inteligencia artificial no existe Kant. Pero ello no es excusa para no podernos valer de la filosofía kantiana y someter a un juicio crítico de la racionalidad a la Inteligencia artificial.

Más allá de lo mucho que se pueda decir al respecto, entre los extremos de considerar, por un lado que la IA piensa y que es un tipo especial de racionalidad, incluso en muchas circunstancias, más rápida y perfecta que la humana; y por otro lado que la IA es una muy buena simulación de la racionalidad humana pero, que definitivamente no es racional en el sentido kantiano de la autonomía y la experiencia subjetiva que exige el Yo; es innegable que la inteligencia artificial puede potenciar las capacidades cognitivas del ser humano, pero nunca podrá —ni deberá— sustituir la sabiduría humana.

Referencias bibliográficas

Aristóteles. (2014). Ética nicomáquea (M. Araujo & J. Marías, trads.). Gredos. (Original publicado c. 350 a. C.). https://www.worldcat.org/title/893414966

Harari, Y. N. (2024). Nexus: una breve historia de las redes de información desde la Edad de Piedra hasta la IA. Debate. https://www.ynharari.com/book/nexus/

Kant, I. (2005). Crítica de la razón pura (P. Ribas, trad.). Taurus. (Original publicado en 1781). https://www.penguinlibros.com/co/libros-de-pensamiento/28470-critica-de-la-razon-pura-9788430605927

Kant, I. (2012). Fundamentación de la metafísica de las costumbres (R. R. Aramayo, trad.). Alianza Editorial. (Original publicado en 1785). https://www.alianzaeditorial.es/libro/biblioteca-de-autor-immanuel-kant/fundamentacion-de-la-metafisica-de-las-costumbres-immanuel-kant-9788420671918/

Nagel, T. (1974). What is it like to be a bat? The Philosophical Review, 83(4), 435–450. https://doi.org/10.2307/2183914

Parlamento Europeo. (2024). Reglamento (UE) 2024/1689 por el que se establecen normas armonizadas en materia de inteligencia artificial (Ley de Inteligencia Artificial). Diario Oficial de la Unión Europea. http://data.europa.eu/eli/reg/2024/1689/oj

Searle, J. R. (1980). Minds, brains, and programs. Behavioral and Brain Sciences, 3(3), 417–424. https://doi.org/10.1017/S0140525X00005756

Comentar